ファクトはAIによる自動抽出です。誤りが含まれる可能性があります。正確な情報は原資料をご確認ください。

経済産業省

実績DX・デジタル

概要

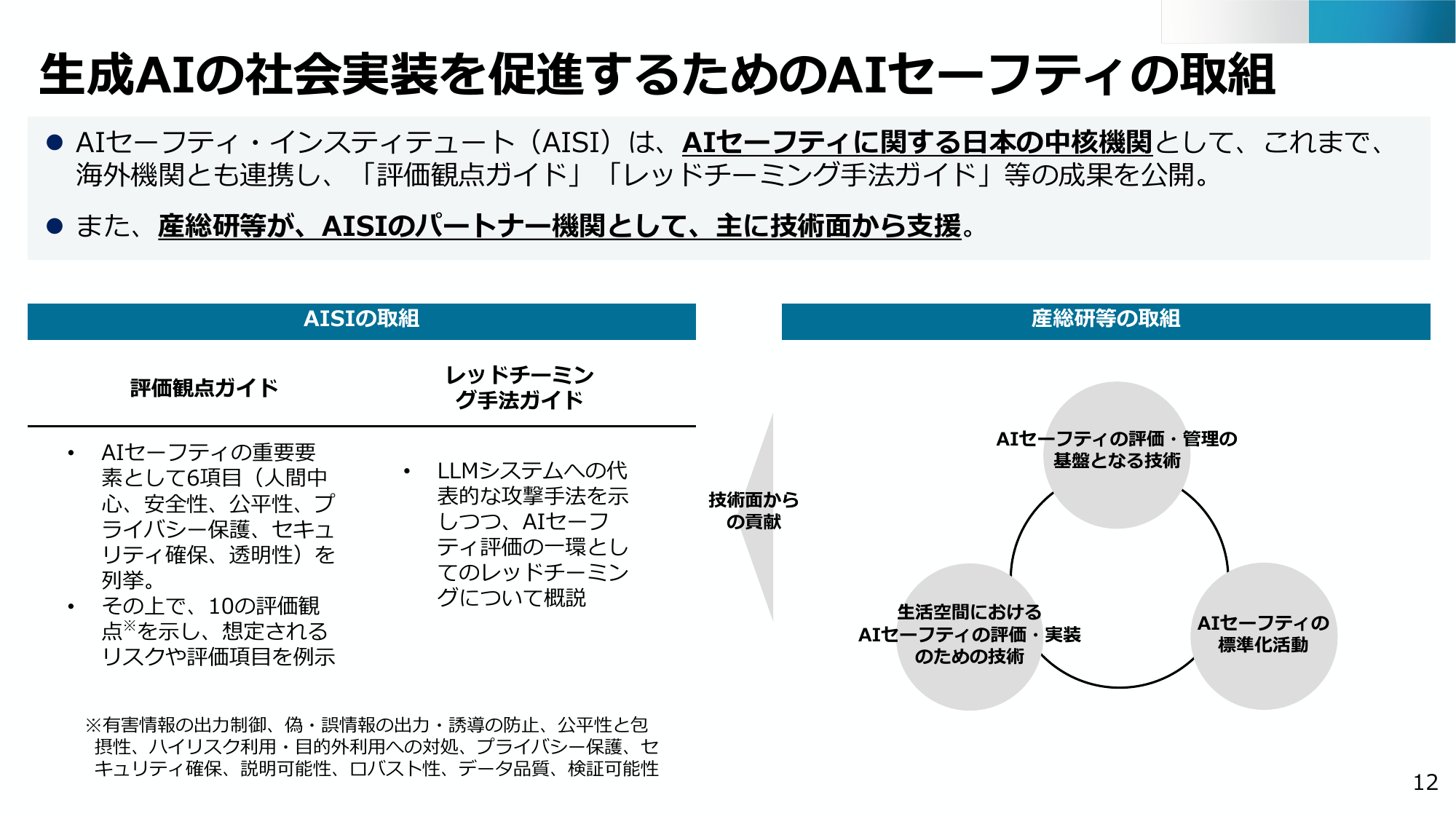

AIセーフティの評価観点として10項目が提示されている。生成AIの社会実装を促進しながら安全性を確保するための評価基準が整備されており、AI開発者や利用者の参照基準となっている。

出典スライド

このスライドの他のファクト

スライドテキスト

生成AIの社会実装を促進するためのAIセーフティの取組 AIセーフティ・インスティチュート(AISI)は、AIセーフティに関する日本の中心機関として、これまで、海外機関とも連携し、「評価観点ガイド」「レッドチーミング手法ガイド」等の成果を公開。 また、産総研等が、AISIのパートナー機関として、主に技術面から支援。 AISIの取組 産総研等の取組 評価観点ガイド レッドチーミング手法ガイド 技術面からの貢献 AIセーフティの評価・管理の基盤となる技術 AIセーフティの重要要素として6項目(人間中心、安全性、公平性、プライバシー保護、セキュリティ確保、透明性)を列挙。 LLMシステムへの代表的な攻撃手法を示しつつ、AIセーフティ評価の一環としてのレッドチーミングについて概説 生活空間におけるAIセーフティの評価・実装のための技術 AIセーフティの標準化活動 その上で、10の評価観点を示し、想定されるリスクや評価項目を例示 ※有害情報の出力制御、偽・誤情報の出力・誘導の防止、公平性 と包摂性、ハイリスク利用・目的外利用への対処、プライバシー保護、セキュリティ確保、説明可能性、ロバスト性、データ品質、検証可能性 12